匯流新聞網記者王佐銘/綜合報導

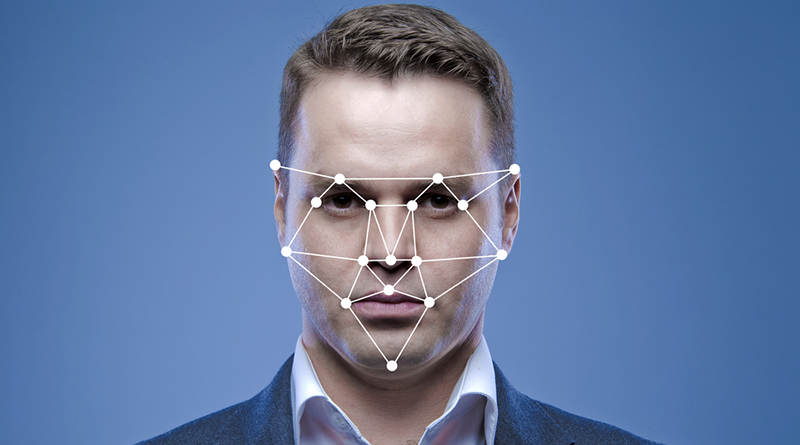

人臉辨識也會種族歧視?美國國家標準暨技術研究院(NIST)研究近兩百種臉部演算法後,發現人臉辨識系統在辨別非白人時會產生較大的誤差,因應人臉辨識被普及用在執法與身分辨識驗證,這項發現很有可能會引發應用上的疑慮。

根據《華盛頓郵報》報導指出,目前的臉部辨識系統,對亞裔、非裔美國人的誤判機率比白人高出100倍左右,這些錯誤很有可能會讓運用人臉辨識系統進行驗證的銀行、邊境管制、機場系統等遭有心人士利用或導致誤判,特別是在執法時面臨一些「種族偏見」問題上更加敏感。

目前演算法有兩種誤判狀況:分別為假陽性與假陰性,可能會錯把兩人辨識為同一人,除了膚色,性別、年齡也有可能會是造成人臉辨識系統誤判的因素之一,其中又以非裔美國女性誤判機率最高。NIST驗證了目前的演算法中存在種族與性別偏見,也讓民眾對辨識系統的可信度產生動搖。

NIST表示,他們交叉演算法採樣來自各家知名科技公司,不過,其中值得注意的是,亞馬遜並未將演算法提供給NIST。除了找出為何演算法會產生種族歧視的原因,期會帶來的影響也不容忽視,美國近期在邊境管制上大量運用人臉辨識系統作為驗證系統,NIST認證辨識系統存在瑕疵後,美國會議員也呼籲川普應該審慎評估這項運用。

新聞照來源:資料照片

《更多匯流新聞網CNEWS報導》

【文章轉載請註明出處】

延伸閱讀

【CNEWS】 「畫面重現」誰習慣性咆哮?鍾佳濱提裝「噪音檢測設備」 翁曉玲喊支持最好「AI抓臉」

- 2024-12-20

- 王 聿瀠

朱國榮落跑補破網 司法院開聯繫會議推電子打卡報到

- 2023-10-25

- 張孝義

以後出門不用帶鑰匙!人臉辨識3E小島電子鎖 守護居家安全更安心

- 2023-05-30

- 李 映萱