匯流新聞網記者王佐銘/綜合報導

近來隨著ChatGPT爆紅,AI話題成為大熱門,最近即有報導指出,目前的AI人工智慧最近已經進化到難以想像的地步,只要花6秒的時間,就可以透過聲音除可以分辨出發言者的性別、年紀與種族外,甚至可以描繪出長相。

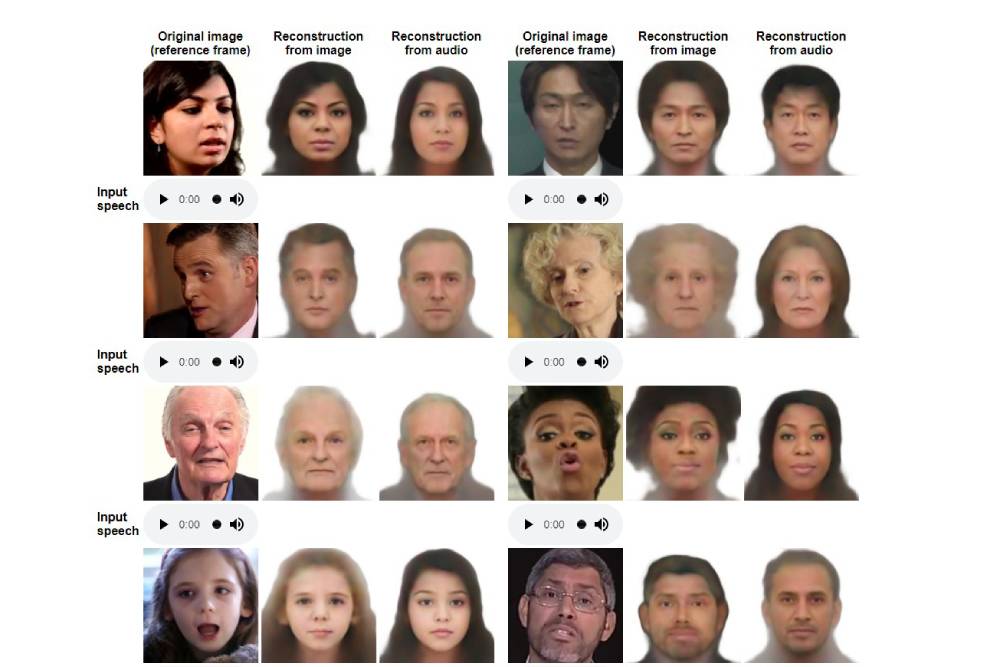

這款由麻省理工學院(MIT)所打造出來的AI,研究人員用一個由數百萬個影片剪輯而成的數據集,對一個名為Speech2Face的神經網路模型進行自我訓練,而這款網路的運作大概分成兩部分,一個是語音編碼器,主要負責對輸入的語音來進行分析,並預測出相關的臉部特徵;另一個則是臉部解碼器,主要對輸入的臉部特徵來進行整合並產生圖像。從最終結果來看,僅用了6秒,就能靠著聲音來還原人臉,效果上是令人滿意的。

該研究團隊表示,他們的目的並非為了準確還原說話者的模樣,Speech2Face模型主要是為了研究語音與相貌之間的關聯性。目前Speech2Face已經可以識別出性別,而對於白種人與亞洲人也能輕易分辨,在年紀部分從30、40、70歲的年齡段聲音命中率會比較高一點。

除了基礎的性別、年紀與種族外,Speech2Face還可以猜中一些臉部特徵,像是鼻子結構、嘴唇厚度與形狀、咬合等情況,也可以猜出大概的臉部骨架,基本上聲音輸入的時間越長,這款AI的準確率就越高;不過研究人員也坦言,AI的聽覺也會有錯,這款AI會將尚未經歷變聲期的小男生當作女性、對說話者的口音也會有判斷錯誤的時候、甚至搞錯年齡等。研究人員表示,Speech2Face之所以會有侷限性,部分原因是因為數據集中的說話者,本身種族多樣性不夠豐富,所以讓它在辨認不同種族人士聲音這樣的能力上是比較弱的。

不過也有人認為這項技術背後所隱藏的隱私與歧視等問題,令人擔憂;他們認為雖然這是純粹的學術調查,但臉部信息的潛在敏感性,是有必要進一步討論當中的道德因素,應該要對此進行嚴謹的技術測試,並確保實際數據可以代表預期中的用戶群。

照片來源:CNEWS資料照片

《更多CNEWS匯流新聞網報導》

IBM發布最新年度資安報告 去年4月至今勒索軟體流量增加800%

【文章轉載請註明出處】